1️⃣ 추천시스템

① 추천 시스템

🔘 정의

- information filtering technique : 어떠한 사람이 관심있을 것 같은 것들을 제공하도록 정보를 filtering 하는 기법

🔘 활용

⭐ 이커머스, 광고, (유튜브 영상) 추천

- 비슷한 취향 similar taste 을 가진 사람들이 봤던 것을/구매했던 것을 광고/추천목록으로 보게됨

- ⭐ 추천시스템에 딥러닝 네트워크를 활발하게 사용하고 있다

🔘 구조

- Candidate generation : 유저의 취향을 고려하여 거대한 corpus (유저, 방대한 비디오 클립 등) 로부터 추천 후보군을 산출한다.

- Scoring : 후보군 중에서 유저가 실제로 볼법한 추천 게시물을 다시 선택하기 위해 정확한 선택 요소들을 점수화한다.

- Re-ranking : 싫어요 수, 다양성, 새로움 등을 기준으로 최종 추천 게시물들에 대해 순서를 조정한다.

👉 Candidate generation 에서 DNN 이 활용되고, Scoring 과 Re-Ranking 는 Hand-engineering 과정으로 이루어진다. 특정 target 을 위한 추천시스템마다 알고리즘이 다르다.

② Candidate Generation approaches

🔘 CB

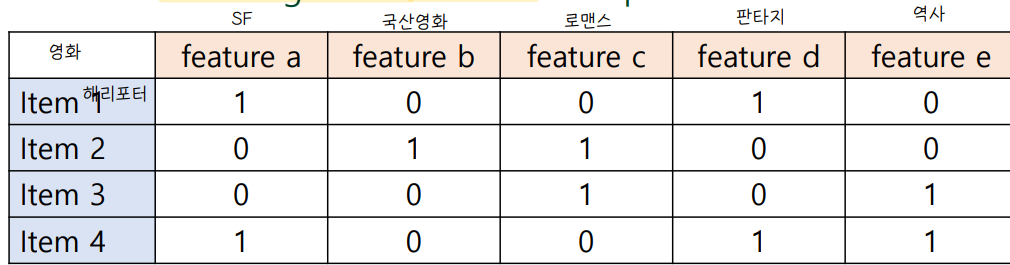

- Contents based filtering : item 간의 유사도를 측정해 유저가 좋아했던 item 과 유사한 item 을 추천하는 방법이다.

- item : 추천 대상들 (영상, 광고, 제품 등)

- ex. A가 item1 을 좋아했다면, 그와 비슷한 item2 를 추천해준다.

🔘 CF

- collaborative filtering : item 과 query 간의 유사도를 측정하여 추천해주는 방식이다.

- query : 추천할 때 사용하는 정보들을 의미한다. 유저의 성별/나이/히스토리/피드백 등이 존재한다.

- CB 보단 정보를 많이 고려하기 때문에 일반적으로 성능이 더 좋다.

- ex. 유저 A 와 유저 B 가 비슷한 취향을 가졌을 때, B가 item2 를 좋아한다면, A 에게도 그 제품을 추천해본다

🔘 Query 와 Item 의 유사도를 측정하는 방법

- s(q,x) : query 와 item 이 같은 임베딩 공간에 위치할 때, query 와 item 간의 유사도를 의미한다.

🔹 Method 1. Cosine

🔹 Method 2. Dot product

- frequency 를 고려한다는 측면에서 많이 사용되는 방식이다.

- item 이 임베딩되면, 자주 구매/본 item 은 벡터의 길이가 클 가능성이 높은데, 이를 고려해줄 수 있다.

- 자주 나왔던 item 들은 자주 추천될 가능성이 높다.

🔹 Method 3. Euclidean distance

2️⃣ Contents-based filtering

① CB

🔘 유저가 좋아했던 아이템과 비슷한 아이템을 추천하는 방식

- item 을 표현하기 위한 feature 는 사람이 직접 설계한다 : hand - engineered feature

- ❓ 유저A 가 item 4 를 좋아한다면, dot product 를 통한 유사도 측정 방식으로 가장 추천해줄만한 item 은 무엇인가?

② 한계점

🔘 hand-engineered feature

- item 을 표현하기 위한 feature 를 사람이 직접 설계해야 하므로 Domain-specific knowledge 가 있어야한다.

- feature 를 어떻게 설계하느냐에 따라 추천시스템의 성능이 좌지우지함

- No use of embeddings

- ex. movie → 영화에 대한 장르/감독..등등 을 알고 있어야 feature 생성이 가능

🔘 Only based on existing interests of the user

- 유저가 이미 가지고 있는 interest 만을 기반으로 추천하기 때문에 다른 요소들이 고려되지 않음 (유저의 past history 만 고려하므로 추천 가지수가 제한됨)

3️⃣ Collaborative filtering

① CF

🔘 query 와 item 을 동시에 고려하여 유사도를 구해 추천하는 방식

- ⭐ 임베딩을 기계가 직접 학습함

- feature 를 만드는데 인간이 직접 설계하지 않아도 된다.

② query 와 value 표현방식

🔘 representation

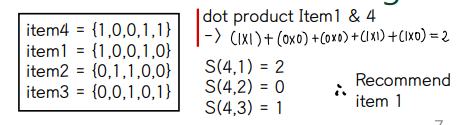

- Sparse representation : 초기의 item 과 query 각각은 원핫벡터로 이루어져 있다.

- Dense representation : item 과 query 각각을 임베딩 벡터로 표현하게 되면 비슷한 item 들끼리 비슷한 임베딩 공간에 위치하게 된다.

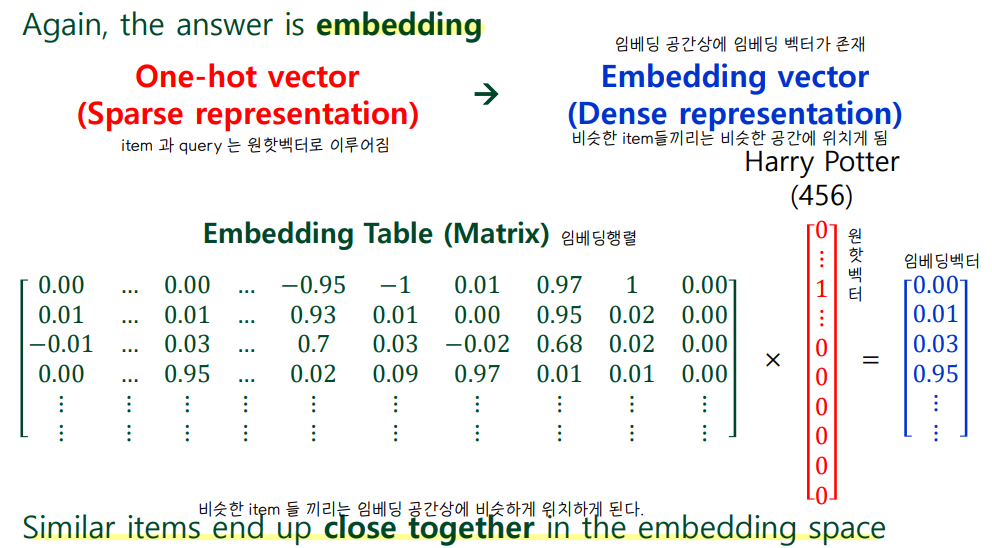

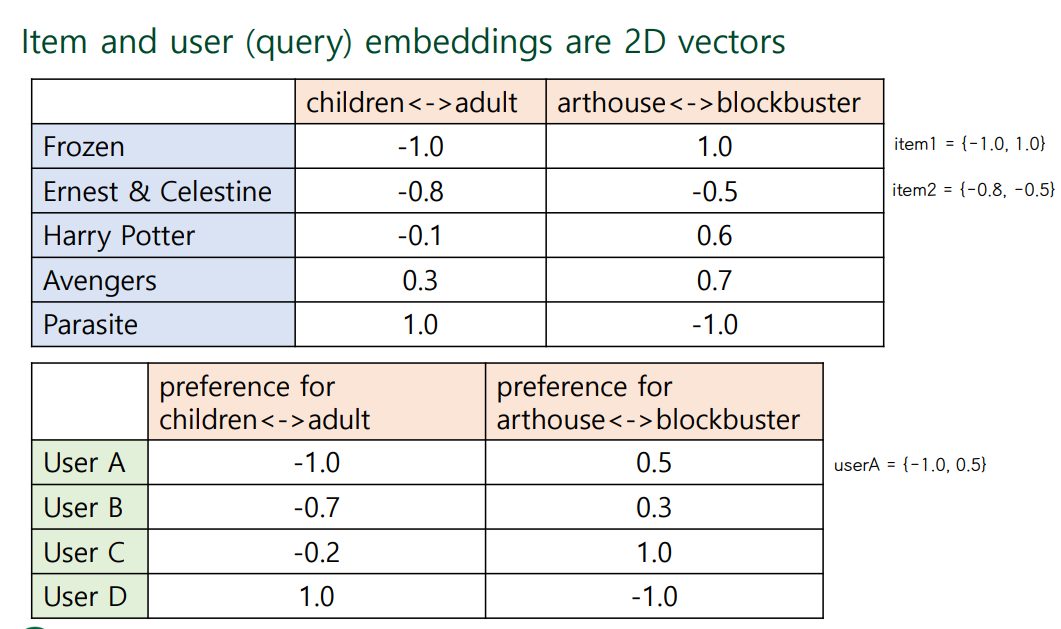

🔘 1-D embedding

- 1D embedding : Item , query 임베딩을 scalar 값으로 표현하는 방법

- Ex. item 에 대해서는 아이들이 보기 적합한 영화와 어른이 보기 적합한 영화에 속하는 정도에 따라 -1~1 사이의 값을 부여하고 user(query) 에 대해서는 해당 기준에 속한 영화의 선호도를 바탕으로 값을 부여한다.

- 위의 설명에서는 쉬운 이해를 위해 Children 과 Adult feature 를 보여주었지만, 임베딩 표현 방식에서는 이 feature 자체를 기계가 스스로 설계한다.

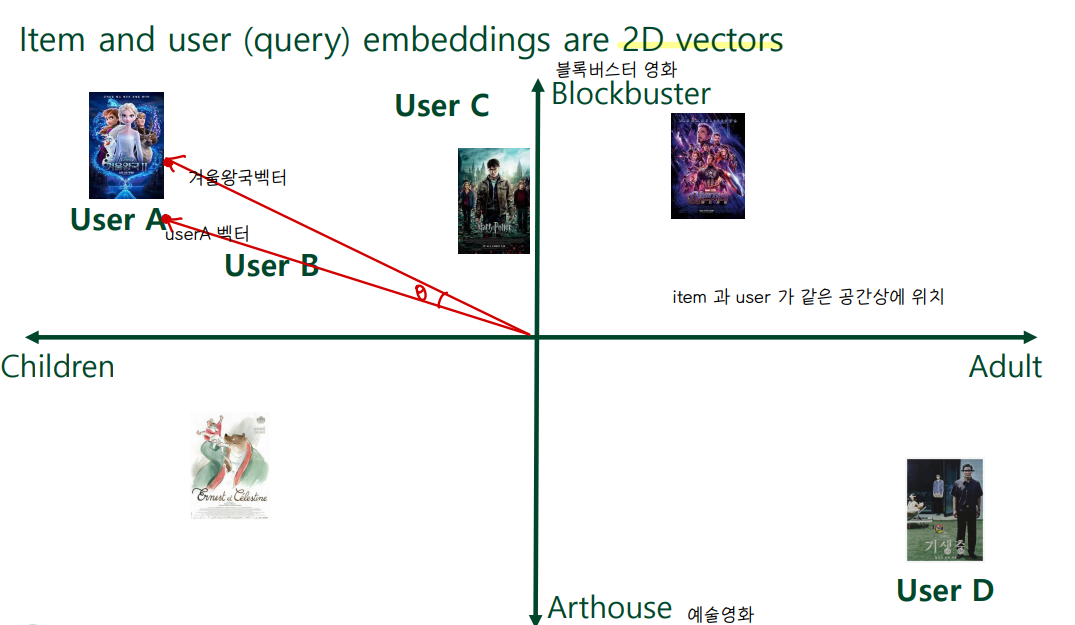

🔘 2-D embedding

- item 과 user 가 같은 임베딩 공간상에 위치한다.

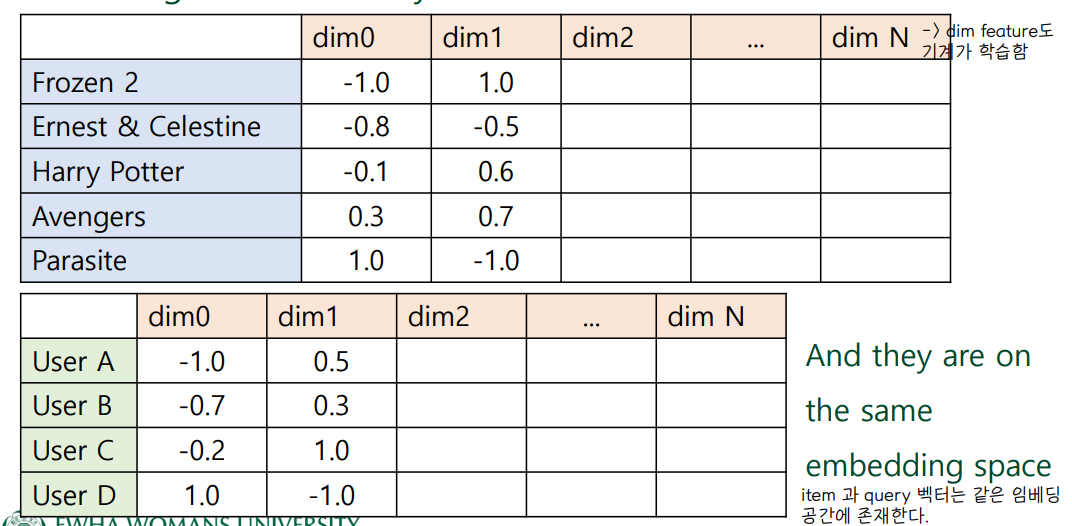

🔘 N-D embedding

- 벡터의 크기가 클수록 더 많은 feature 요소들을 고려할 수 있다.

- 기계가 직접 임베딩 벡터를 계산한다 👉 dim feature 도 기계가 학습하여 도출한다. 추상적 공간에서 기계가 추천이 잘 이루어지도록 하는 임베딩 테이블을 학습 결과로 내놓는다.

- item 과 query 벡터는 같은 임베딩 공간 내에 존재한다.

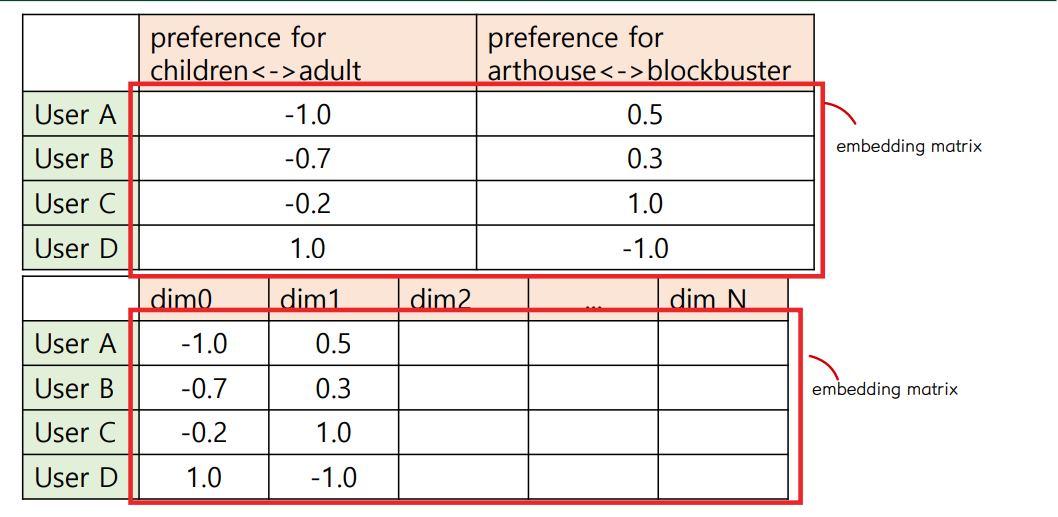

② Embedding 행렬을 얻는 방법

- If user is represented by one-hot vectors, these tables become embedding matrices 👉 user 가 원핫벡터로 표현된다면 임베딩 테이블에서 lookup 을 하는 방식으로 임베딩 벡터로 읽어올 수 있다.

🔘 방법1. matrix multiplication

- 전통적인 기계학습 방법 (SVD) 에 해당한다.

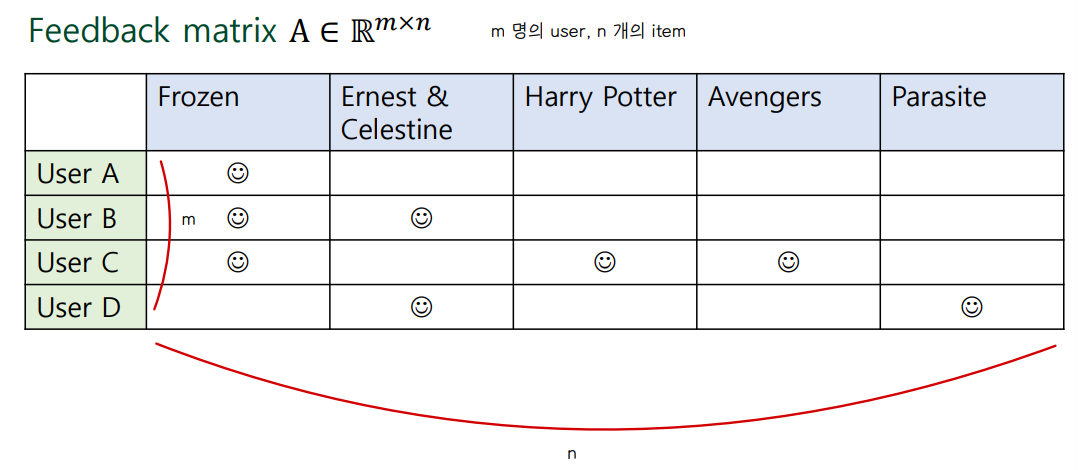

💨 Feedback matrix 를 얻는다

- feedback matrix : 유저가 각 item 에 대해 어떤 피드백 (평점, 좋아요 수 등) 을 주었는지에 관한 행렬

- implicitly by looking at past history of users : 해당 영화를 봤다면 1, 아니면 0 처럼 간접적으로 유추해서 얻는 피드백 내용에 해당

- explicitly by collecting a direct feedback from users (likes & dislikes) : user 가 직접적인 의견으로 피드백을 주는 경우에 해당

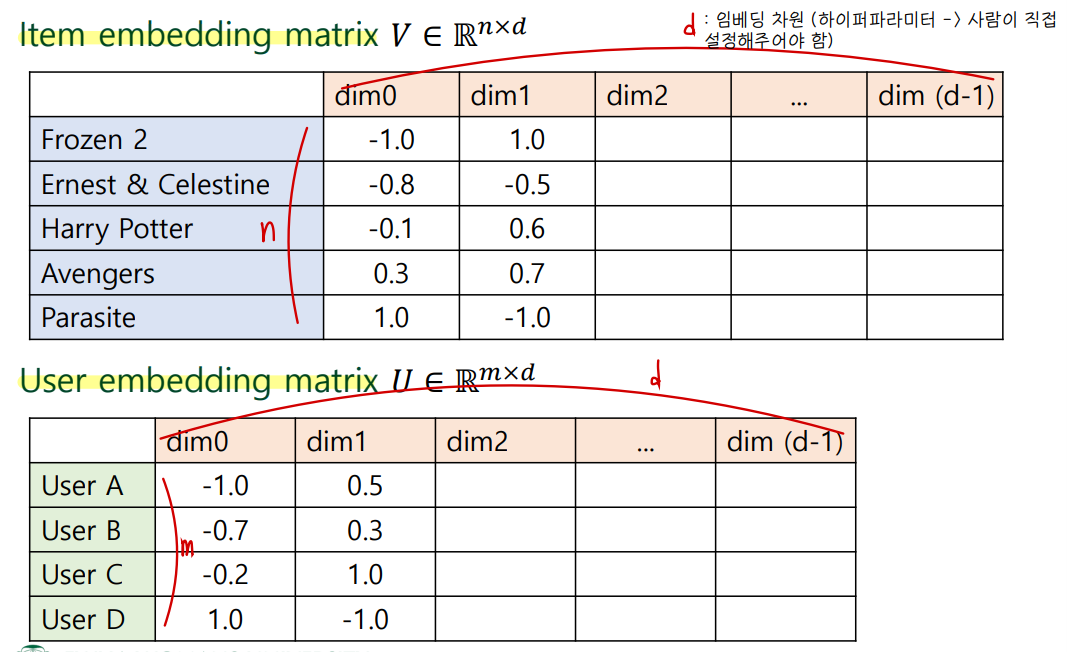

💨 Item 과 user embedding matrix 를 준비한다.

- item embedding matrix : n개의 item, 임베딩 차원 d (d는 사람이 직접 설정해주어야 함)

- user embedding matrix : m 명의 user, 임베딩 차원 d

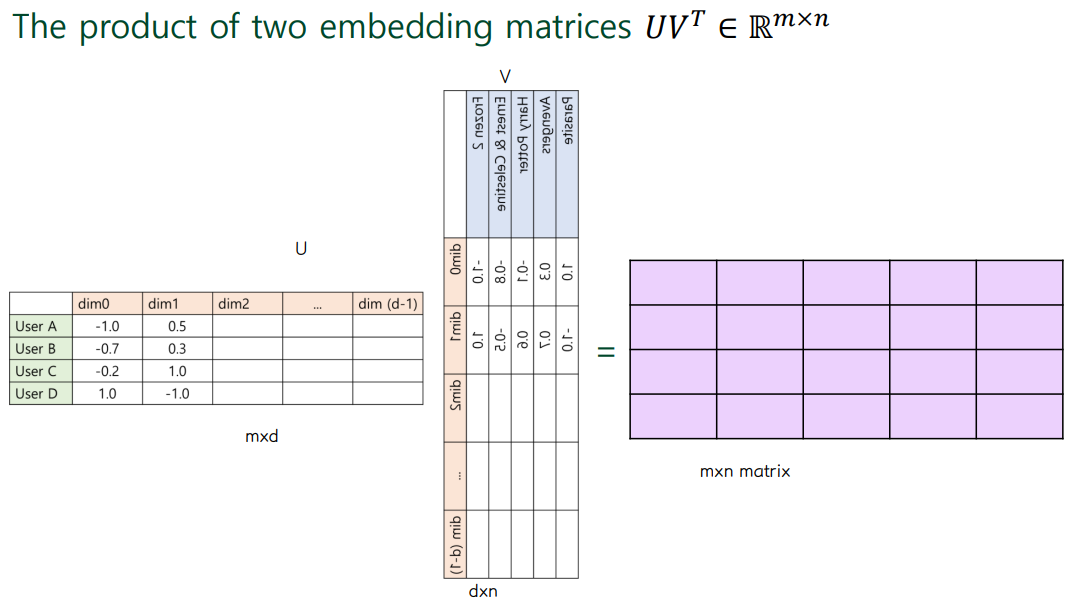

💨 Item 과 user embedding matrix 를 내적한다.

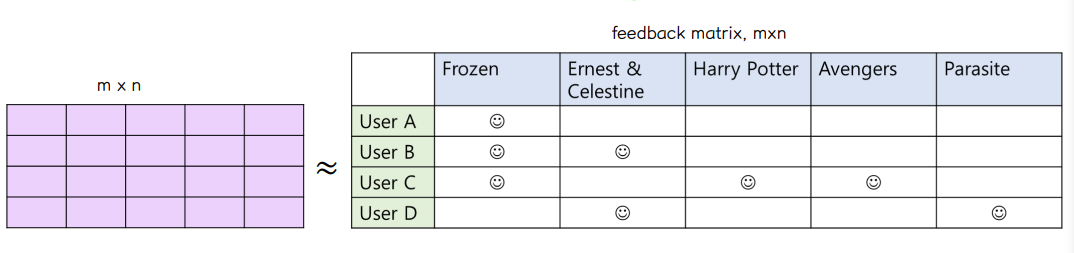

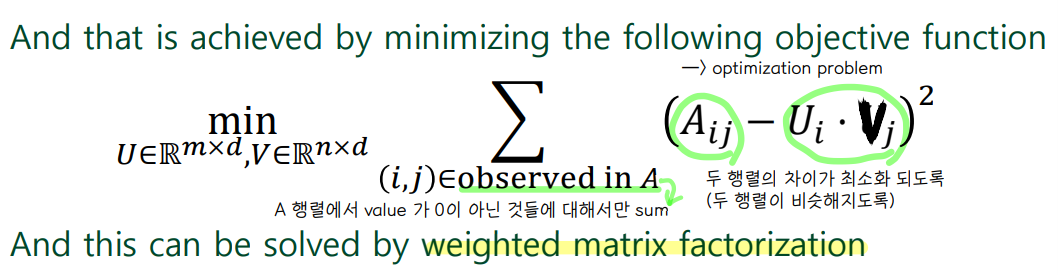

💨 UV' 행렬을 feedback matrix 행렬 A 에 근접하게 만든다.

- 두 행렬을 approximation 하는 과정은 아래와 같이 optimization problem 으로 정의할 수 있다.

👀 한계점

- The difficulty of using any features beyond queries and items present in the training set 👉 훈련데이터셋에 존재하는 query, item 이외의 다른 피처가 입력된다면 이에 대해서는 새롭게 다시 임베딩 테이블을 만들어서 matrix factorization 을 해주어야 한다. ex. query = (user gender, user age) ← user mbti feature 를 추가하는 경우

- 인기있는 item 들은 모든 사람들에게 추천되는 경향이 있다 👉 user specific 한 정보들은 훈련시 포함이 어렵기 때문에 개인화된 추천이 어렵다.

그러나, 딥러닝 방법은 input 에 대한 유연성이 존재한다.

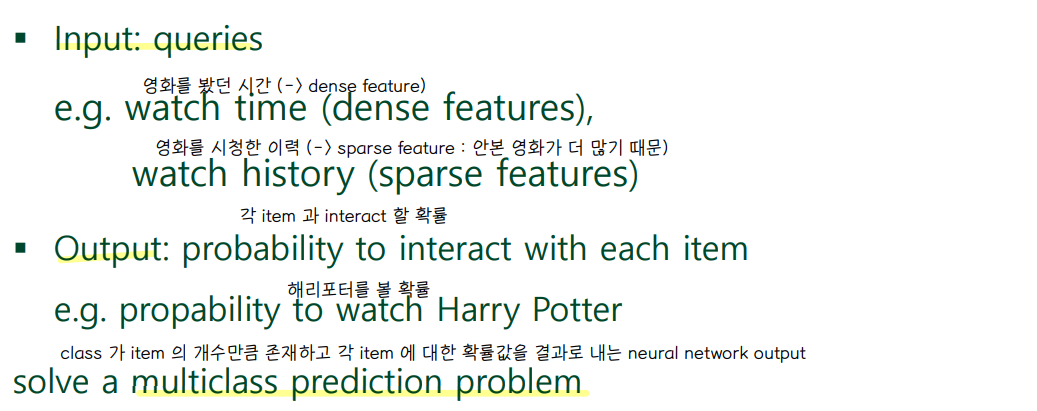

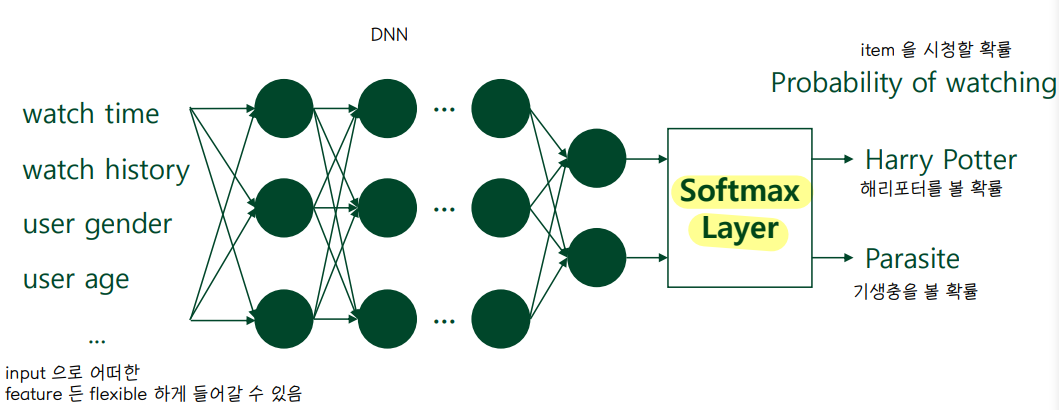

🔘 방법2. DNN

- input 으로 어떠한 feature 는 flexible 하게 넣을 수 있다.

- Output 은 해당 추천 대상을 구매/시청할 확률값

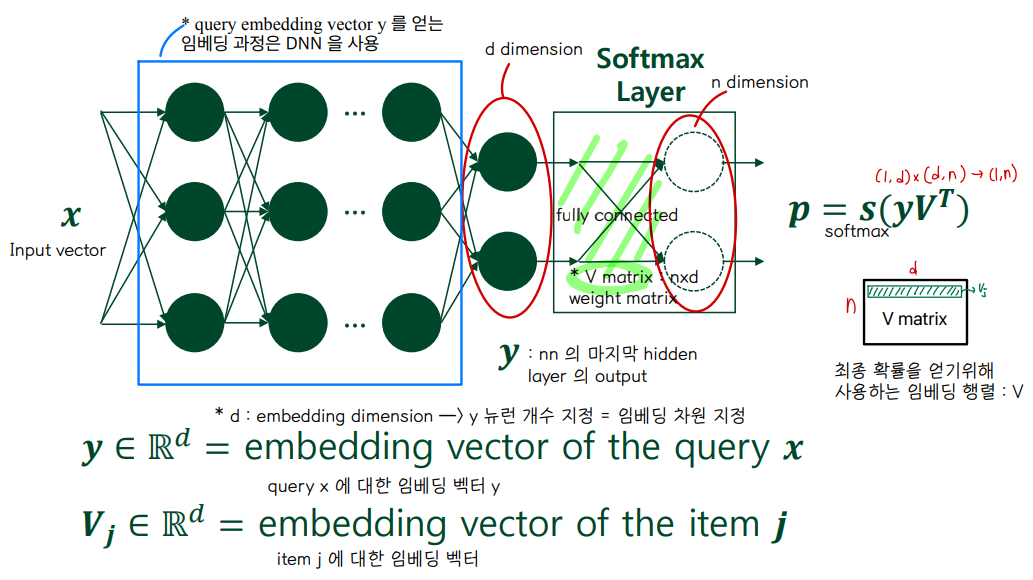

- input 형태에 유연성이 존재하며 training 과정에서 발생하는 부산물들이 앞서 언급한 임베딩 벡터가 된다.

- y : query x 에 대한 임베딩 벡터 , (1xd) 차원

- V : 소프트맥스를 거치기 전에 사용하는 임베딩 행렬 , (d,n) 차원

- p = softmax(yV') : (1xn) 차원

- n : item 개수

- d : embedding 차원

'1️⃣ AI•DS > 📒 딥러닝' 카테고리의 다른 글

| [인공지능] Reinforcement Learning (0) | 2022.06.14 |

|---|---|

| [인공지능] GNN (0) | 2022.06.14 |

| [인공지능] GAN (0) | 2022.06.13 |

| [인공지능] Transformer Models (0) | 2022.06.11 |

| [인공지능] NLP (0) | 2022.06.10 |

댓글