► [Remind] 프롬프트에 요청의 맥락 정보를 추가해 LLM의 생성 품질을 향상하는 RAG

► [Key] 텍스트를 숫자로 표현하려던 다양한 시도 > AI분야에서는 텍스트를 의미를 담아 더 압축적인 임베딩 벡터를 만드는 방향으로 발전해옴

1. 텍스트 임베딩 이해하기

► RAG에서 질문과 맥락 정보의 텍스트가 정확히 일치하지 않더라도 검색이 가능한 것은 '임베딩' 표현 방식 때문이다. 텍스트 임베딩(=문장 임베딩) 모델은 문장의 의미를 담아 임베딩 벡터로 변환하므로, 문자열이 동일하지 않더라도 검색이 가능하다. 유사도 기반으로 검색하는 방법을 Semantic search (의미검색)이라고 한다.

► 임베딩 : 데이터의 의미를 압축한 숫자 배열

1.1 문장임베딩 방식의 장점

❍ 텍스트 임베딩 (=문장임베딩)

↪︎ 데이터의 의미를 숫자로 표현할 수 있다면, 데이터가 서로 유사한지, 관련있는지 등의 중요한 정보를 활용 가능

↪︎ 문장 임베딩 방식을 사용하면 코사인유사도 등을 통해 단어나 문장 사이의 관계를 계산할 수 있다 (ex. 학교-공부 : 0.6만큼 유사, 학교-운동 : 0.3만큼 유사)

from sentence_transformers import SentenceTransformer

from sklearn.metrics.pairwise import cosine_similarity

# SentenceTransformer 라이브러리를 사용해 문장임베딩 구현

smodel = SentenceTransformer('snunlp/KR-SBERT-V40K-klueNLI-augSTS')

dense_embeddings = smodel.encode(['학교', '공부', '운동'])

cosine_similarity(dense_embeddings) # 코사인 유사도

# array([[1.0000001 , 0.5950744 , 0.32537547],

# [0.5950744 , 1.0000002 , 0.54595673],

# [0.32537547, 0.54595673, 0.99999976]], dtype=float32)

1.2 원핫인코딩

❍ 원핫인코딩

↪︎ 학교 = [1, 0, 0] , 공부 = [0, 1, 0], 운동 = [0, 0, 1] 식으로 표현하는 방법이다. 원핫인코딩은 범주형 데이터 사이에 의도하지 않은 관계가 담기는 것을 방지한다는 장점이 있지만, 충분히 관련이 있는 단어 사이의 관계도 표현할 수 없다는 단점이 있다. 가령, 학교와 공부 사이에는 '배운다' 는 공통점이 있으나 원핫인코딩에서는 그 의미를 살릴 수 없다.

import numpy as np

from sklearn.metrics.pairwise import cosine_similarity

word_dict = {"school": np.array([[1, 0, 0]]),

"study": np.array([[0, 1, 0]]),

"workout": np.array([[0, 0, 1]])

}

# 두 단어 사이의 코사인 유사도 계산하기

cosine_school_study = cosine_similarity(word_dict["school"], word_dict['study']) # 0

cosine_school_workout = cosine_similarity(word_dict['school'], word_dict['workout']) # 0

↪︎ 학교와 공부의 유사도, 학교와 운동의 유사도가 모두 0으로 나온다.

1.3 백오브워즈

❍ 백오브워즈

↪︎ 비슷한 단어가 많이 나오면 비슷한 문장 또는 문서라는 가정을 활용해 문서를 숫자로 변환한다. "단어의 순서에 관계없이" 해당 문서에 등장한 단어와 그 "등장 횟수" 를 집계한다. 가령, 경제기사에는 '대출', '부동산', '증시'라는 단어가 자주 등장하고, IT기사에는 경제기사보다 '부동산' 등장 횟수는 낮을 것이다.

↪︎ 직관적이고 간단해서 자주 사용하나, 백오브워즈 방식은 어떤 단어가 많이 나왔다고 하여 문서의 의미를 파악하는 데 크게 도움이 되지 않는 문제가 있다. 가령 은/는/이/가 같은 조사는 거의 모든 한국어 문서에 등장한다. 또한 범용적으로 자주 쓰이는 단어는 (ex.AI) 문서의 의미를 구별하기 어렵게 된다.

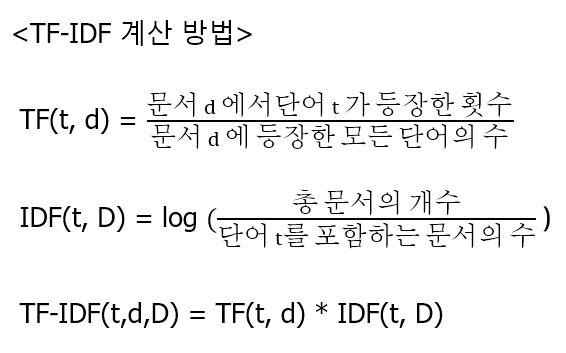

1.4 TF-IDF

❍ TF-IDF

↪︎ BoW의 한계였던 '어느 문서에나 나오는 단어' 문제를 보완하기 위해, 특정 문서에서 특정 단어가 등장한 횟수와, 특정 단어가 등장한 문서의 수를 활용해, 어느 문서에나 자주 등장하는 단어는 중요도를 작게하는 계산식을 사용한다.

❍ 희소벡터 (Sparsity)

↪︎ 원핫인코딩, 백오브워즈, TF-IDF는 문서에 등장하는 단어의 수만큼 차원이 커지기 때문에, 만약 총 10,000개의 단어가 전체 문서에서 사용되었다면, 하나의 문장과 문서를 표현하기 위해 10,000차원의 벡터를 사용하게 되어 필연적으로 대부분의 수가 0인 벡터(희소벡터)가 된다는 문제가 발생한다. 희소한 벡터는 의미를 '압축'해서 담고있지 못하므로 벡터와 벡터 사이의 관계를 활용하기 어렵다.

❍ 밀집임베딩 (Dense embedding)

↪︎ 워드투벡과 문장 임베딩은 보통 100~1000차원 정도로 훨씬 압축된 형태인데, 희소한 벡터와 대비해 밀집임베딩이라고 부른다.

1.5 워드투백

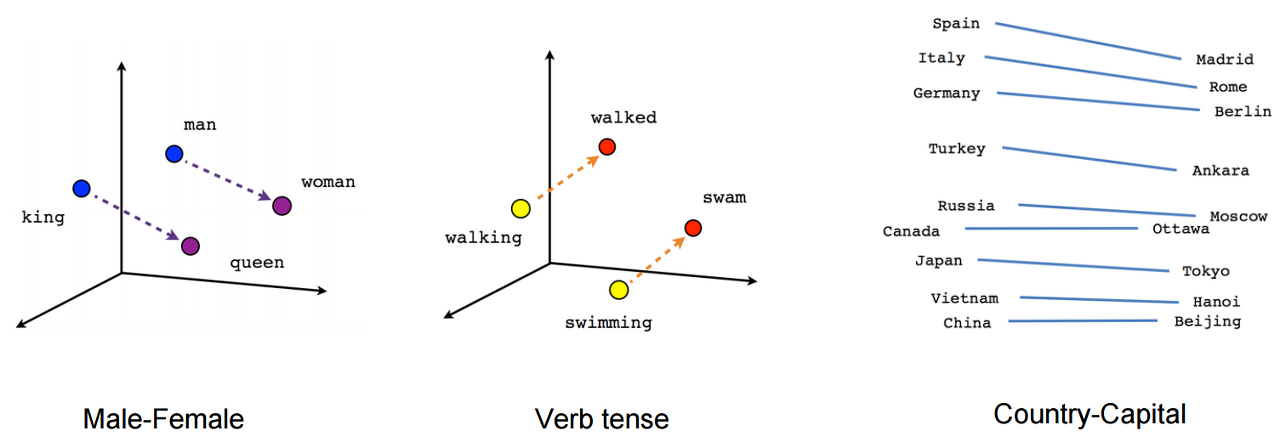

❍ Word2Vec

↪︎ 단어가 '함께 등장하는 빈도' 정보를 활용해 단어의 의미를 압축하는 단어 임베딩 방법 (ex. AI&ML, 한강&자전거)

↪︎ 특정 단어 주변에 어떤 단어가 있는지 예측하는 모델을 통해, 단어의 의미를 표현한 임베딩을 모델이 생성하도록 한다.

↪︎ CBOW : 주변 단어로 가운데 단어를 예측하는 방식

↪︎ SkipGram : 중간 단어로 주변 단어를 예측하는 방식

↪︎ 주변 단어를 예측하는 방식을 사용해 학습한 모델로 단어를 임베딩 벡터로 변환했을 때, '여자'라는 단어와 '남자'라는 단어의 임베딩 벡터 사이의 거리와 방향이 '여왕'과 '왕' 사이의 거리 및 방향과 비슷하게 나왔다. 단어의 의미를 압축해 숫자로 표현하면 단어와 단어 사이의 관계를 계산할 수 있고, 그 관계에도 의미가 담겨져 있다.

2. 문장 임베딩 방식

2.1 문장 사이의 관계를 계산하는 두 가지 방법

❍ 문장임베딩

↪︎ 텍스트를 활용할 때는 단어단위보다는, 문장이나 문단 단위 같은 더 큰 단위를 사용한다. 문장 임베딩을 활용하면 문장 사이의 유사도나 관련성을 벡터 연산을 통해 쉽게 계산할 수 있다.

↪︎ 트랜스포머 인코더 구조를 활용한 BERT는 입력 문장을 문장 임베딩으로 변환하는데 뛰어난 성능을 보인다.

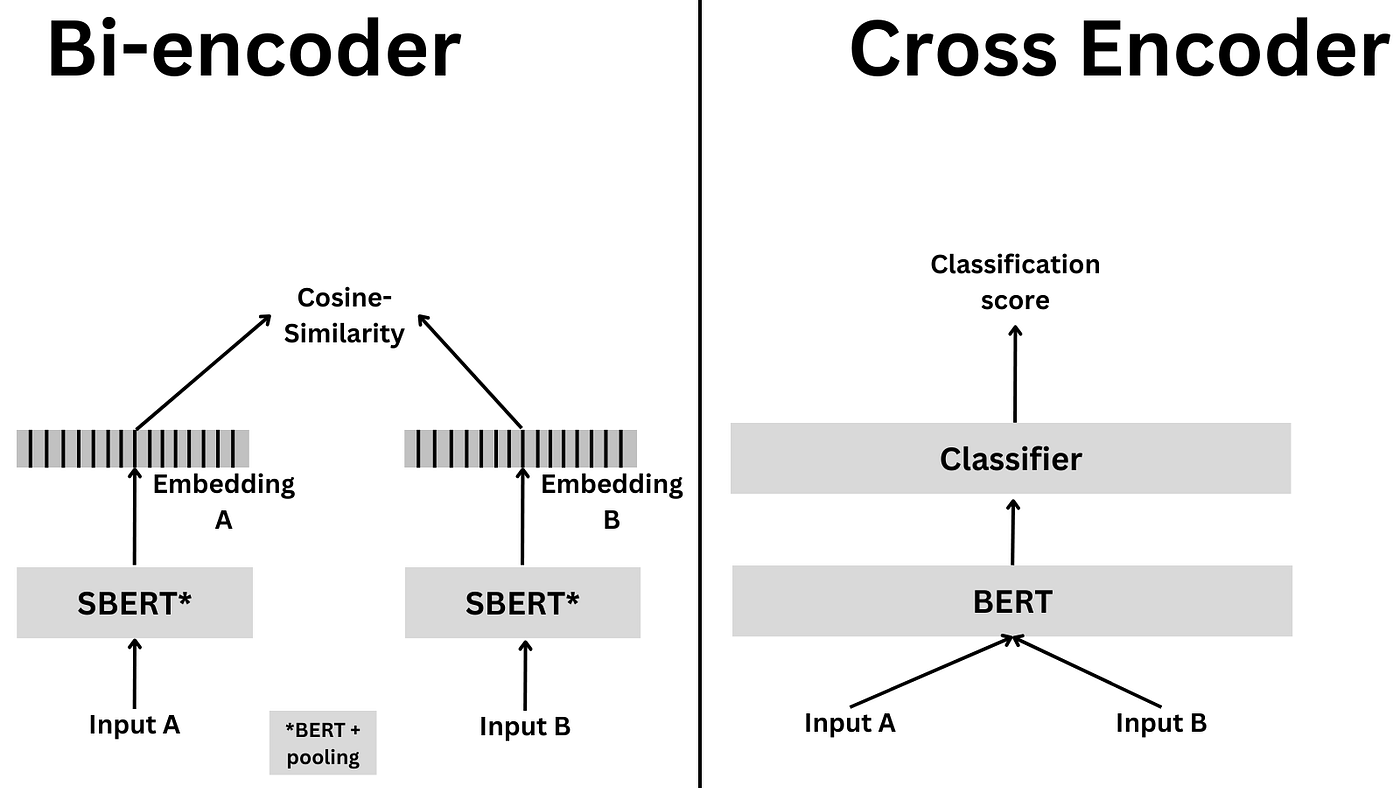

❍ BERT의 문장 사이의 관계를 계산하는 방식

↪︎ 1) 교차인코더

☇ 두 문장을 함께 BERT 입력으로 넣고 모델이 직접 두 문장 사이의 관계를 0과 1사이의 값으로 출력한다.

☇ 계산량이 많지만, 두 문장의 상호작용을 고려하여 더 정확한 관계 예측이 가능하다.

☇ 그러나, 다른 문장과 검색 쿼리의 유사도를 알고 싶을 때 동일 연산을 반복해야 해서 모든 문장 조합에 대해 유사도를 계산해야 하기 때문에 확장성이 떨어진다.

↪︎ 2) 바이인코더

☇ 각 문장을 독립적으로 BERT 입력으로 넣고, 모델 출력 결과인 문장 임베딩 벡터 사이의 유사도를 코사인유사도와 같은 별도의 계산을 통해 구한다.

☇ 독립적으로 임베딩을 계산하기 때문에, 유사도를 계산하고 싶은 문장이 바뀌더라도 추가적인 연산이 필요 없다.

2.2 바이인코더 모델 구조

❍ 바이인코더

↪︎ 바이인코더는 BERT모델의 출력을 풀링층을 통해 고정된 크기의 문장 임베딩으로 만든다.

↪︎ BERT는 입력 토큰마다 출력 임베딩을 생성한다. 따라서 입력하는 문장 길이가 달라질 경우 출력하는 임베딩수가 달라지는데, 문장의 길이가 서로 다를 때 다른 개수의 임베딩이 반환된다면 문장 사이의 유사도를 계산하기 어려워지므로 풀링층을 사용해 문장을 대표하는 1개의 임베딩으로 통합시킨다.

↪︎ 풀링층을 사용해, 문장의 길이가 달라져도 1개의 고정 차원이 반환되므로 코사인유사도 연산을 할 때 거리를 쉽게 계산할 수 있다.

❍ Sentence-Transformers

↪︎ bi-encoder 구현이 가능한 라이브러리

from sentence_transformers import SentenceTransformer, models

# 사용할 BERT모델

word_embedding_model = models.Transformer('klue/roberta-base')

# 풀링 층에 토큰 임베딩 차원 입력하기 : models.Pooling()

pooling_model = models.Pooling(word_embedding_model.get_word_embedding_dimension())

# 두 모듈 결합

model = SentenceTransformer(modules=[word_embedding_model, pooling_model])

↪︎ model출력을 해보면 3가지 Pooling 모드가 보인다. Pooling 모드란 언어 모델이 출력한 겨로가 임베딩을 고정된 크기의 문장 임베딩으로 통합할 때 통합하는 방식을 말한다.

☇ 1) pooling_mode_cls_tokens : 첫번째 토큰인 [CLS] 토큰의 출력임베딩을 문장 임베딩으로 사용

☇ 2) pooling_mode_mean_tokens : BERT 모델에서 모든 입력 토큰의 출력 임베딩을 평균한 값을 문장임베딩으로 사용

☇ 3) pooling_mode_max_tokens : BERT 모델의 모든 입력 토큰의 출력 임베딩에서 문장 길이 방향에서 최댓값을 찾아 문장 임베딩으로 사용

2.3 Sentence-Transformers로 텍스트와 이미지 임베딩 생성해 보기

❍ 한국어 문장 임베딩 모델로 입력 문장 사이의 유사도 계산

↪︎ Sentence-Transformers 라이브러리는 허깅페이스 모델을 불러와 쉽게 사용할 수 있도록 지원한다. 따라서 허깅페이스 모델 허브에서 제공하는 모델이라면 텍스트 뿐 아니라 이미지 모델도 불러와 사용할 수 있다.

from sentence_transformers import SentenceTransformer, util

model = SentenceTransformer('snunlp/KR-SBERT-V40K-klueNLI-augSTS')

# 한국어 문장 임베딩 모델을 불러옴

embs = model.encode(['잠이 안 옵니다',

'졸음이 옵니다',

'기차가 옵니다']) # 문장 인코딩

cos_scores = util.cos_sim(embs, embs) # 코사인 유사도 계산

print(cos_scores)

# tensor([[1.0000, 0.6410, 0.1887],

# [0.6410, 1.0000, 0.2730],

# [0.1887, 0.2730, 1.0000]])

❍ CLIP모델을 활용한 이미지와 텍스트 임베딩 유사도 계산

↪︎ 고양이, 강아지 이미지와, 이미지를 묘사하는 텍스트 사이의 유사도 계산 > 동물 이미지와 동물 텍스트끼리 대응했을 때 유사도가 더 높음 (반대면 유사도 점수가 낮음)

from PIL import Image

from sentence_transformers import SentenceTransformer, util

model = SentenceTransformer('clip-ViT-B-32')

img_embs = model.encode([Image.open('dog.jpg'), Image.open('cat.jpg')])

text_embs = model.encode(['A dog on grass', 'Brown cat on yellow background'])

cos_scores = util.cos_sim(img_embs, text_embs)

print(cos_scores)

# tensor([[0.2771, 0.1509],

# [0.2071, 0.3180]])

2.4 오픈소스와 상업용 임베딩 모델 비교하기

❍ 오픈소스모델

↪︎ Sentence-Transformers 라이브러리를 사용해 사전학습 모델을 불러와 활용하는 방식

↪︎ 자신의 데이터에 맞춰 fine-tuning을 할 수 있다는 장점이 있음

❍ 상업용모델

↪︎ Open AI 의 text-embedding-ada-002

↪︎ 대량의 데이터로 학습된 만큼 성능이 뛰어남

↪︎ LLM 텍스트 생성에 비해 낮은 비용으로 사용이 가능

'1️⃣ AI•DS > 🌏 LLM' 카테고리의 다른 글

| 11. 자신의 데이터에 맞춘 임베딩 모델 만들기 : RAG 개선하기 (0) | 2025.10.19 |

|---|---|

| [책스터디] 10-(2). 실습 : 의미검색 구현하기 (0) | 2025.09.19 |

| [책스터디] 9. LLM 애플리케이션 개발하기 (1) | 2025.09.08 |

| [책스터디] 8. sLLM 서빙하기 (0) | 2025.09.06 |

| [책스터디] 7. 모델 가볍게 만들기 (3) | 2025.08.23 |

댓글